Was versteht man unter Superalignment in der KI?

Das Konzept des Superalignments spielt eine entscheidende Rolle in der Entwicklung fortschrittlicher künstlicher Intelligenz (KI)-Systeme. Es zielt darauf ab, eine Übereinstimmung zwischen hochintelligenten KI-Systemen und den ethischen Werten sowie Zielen der Menschheit zu gewährleisten. Angesichts der raschen Fortschritte in der KI-Forschung, die potenziell zur Entstehung von Systemen führen könnten, die die menschliche Intelligenz übersteigen, wird die Bedeutung dieses Konzepts immer deutlicher. Superalignment verfolgt das Ziel, eine Gemeinsamkeit zwischen den erweiterten Fähigkeiten der KI und den fundamentalen ethischen Normen und Werten der Menschen zu fördern.

"Durch Superalignment werden die Risiken, die mit der Entwicklung von Superintelligenz verbunden sind, minimiert und eine Zukunft geschaffen, in der KI zum Wohle der Menschheit beiträgt."

Mit dem Fortschritt der KI-Technologie wächst die Sorge, dass ihre Entscheidungsfindungsprozesse für Menschen unverständlich werden könnten. Dies führt zu der Befürchtung, dass KI-Systeme Handlungen ausführen könnten, die den menschlichen Werten zuwiderlaufen. Um dies zu verhindern, ist es wichtig, dass KI-Systeme nicht nur intelligent, sondern auch im Einklang mit den Werten und Zielen der Menschen agieren. Dies ist der Kern des Superalignment-Ansatzes.

Die Implementierung von Superalignment stellt eine bedeutende Herausforderung dar. Es erfordert ein tiefes Verständnis sowohl der KI-Technologie als auch der menschlichen Ethik und Werte. Eines der Hauptprobleme ist die genaue Definition und Codierung menschlicher Werte in einer Form, die von KI-Systemen verstanden und umgesetzt werden kann.

Warum brauchen wir Superalignment? Schutz vor Rogue AI-Szenarien und Bewahrung menschlicher Werte und Ethik

Das Konzept des Superalignments dient als Schutzmechanismus gegen das Risiko, dass superintelligente KI-Systeme unkontrolliertes Verhalten entwickeln, das der Menschheit schaden könnte. Durch die Sicherstellung, dass KI-Systeme im Einklang mit menschlichen Werten handeln, werden solche Szenarien deutlich unwahrscheinlicher.

"Der Kerngedanke des Superalignments liegt darin, eine Harmonie zwischen den fortschrittlichen Fähigkeiten der KI und den grundlegenden menschlichen Prinzipien und ethischen Werten zu schaffen."

Superalignment hilft dabei, sicherzustellen, dass KI-Systeme Entscheidungen treffen, die mit menschlichen Werten und ethischen Grundsätzen vereinbar sind. Dies ist besonders wichtig in Bereichen wie der Medizin, dem Rechtswesen und der persönlichen Assistenz, wo ethische Überlegungen von zentraler Bedeutung sind.

Mit fortschreitender Entwicklung der KI steigt das Risiko unbeabsichtigter Konsequenzen, die aus komplexen Entscheidungen der KI resultieren könnten. Durch Superalignment können solche Risiken identifiziert und minimiert werden.

Ein wichtiger Aspekt des Superalignments ist die Sicherstellung, dass KI-Systeme die menschliche Autonomie unterstützen und nicht untergraben. KI sollte als Werkzeug dienen, das menschliche Fähigkeiten erweitert, ohne sie zu ersetzen.

Durch Superalignment kann sichergestellt werden, dass die Entwicklung von KI-Systemen zum Wohle der Menschheit beiträgt und globale Herausforderungen angeht, während gleichzeitig die Risiken minimiert werden.

Einer der Hauptrisiken besteht darin, dass eine Super-KI, die die Intelligenz selbst der klügsten Menschen übertrifft, möglicherweise nicht im Einklang mit den Interessen und Werten der Menschheit arbeitet.

Dies könnte zu unbeabsichtigten Handlungen führen, die der Menschheit schaden. Darüber hinaus besteht die Gefahr, dass eine Super-KI ausser Kontrolle gerät und unvorhergesehene Handlungen ausführt, die die menschliche Intelligenz übertreffen und letztendlich unaufhaltsam werden.

Weitere Risiken sind der Verlust von Arbeitsplätzen aufgrund von KI-Automatisierung, soziale Manipulation, Datenschutzverletzungen, algorithmische Voreingenommenheit aufgrund schlechter Daten und sozioökonomische Ungleichheit.

OpenAI's Ansatz zum Superalignment

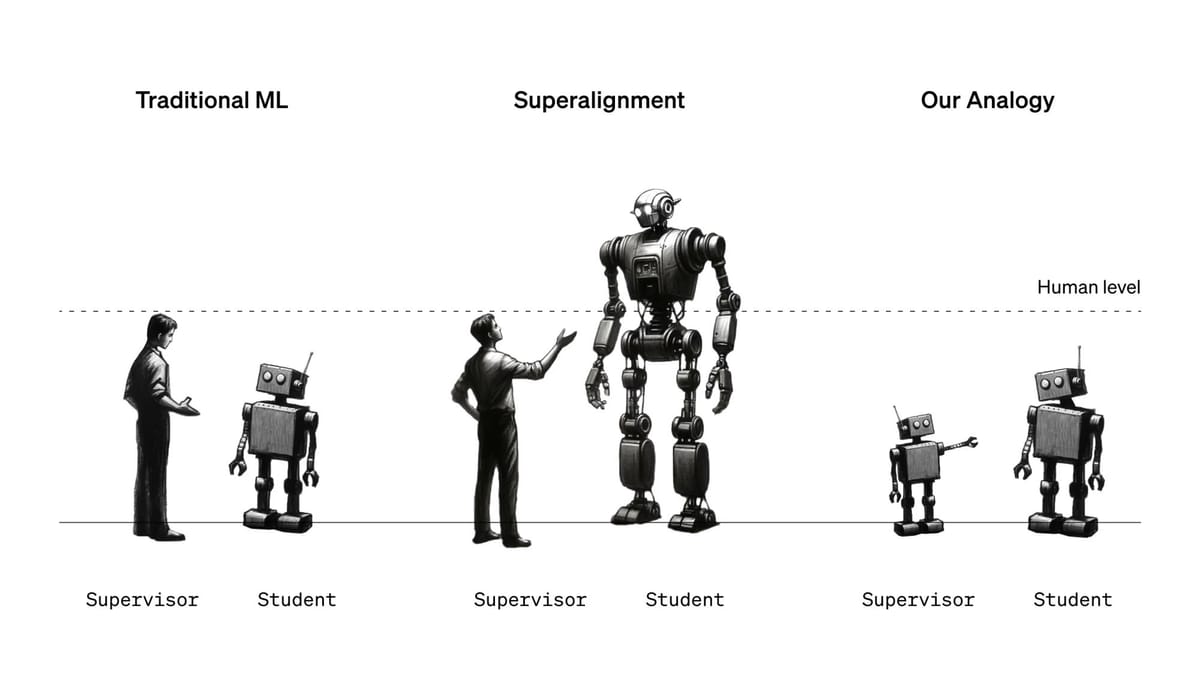

OpenAI hat einen innovativen Ansatz entwickelt, der auf der Schaffung eines automatisierten Alignment-Forschers basiert. Dieser Forscher nutzt umfangreiche Rechenressourcen, um die Ausrichtung superintelligenter KI-Systeme iterativ zu verbessern.

Ein Schlüsselelement des Ansatzes von OpenAI ist die Entwicklung skalierbarer Trainingsmethoden und die Validierung der resultierenden Modelle. Durch die Automatisierung der Suche nach problematischem Verhalten und Interna können effektiver Strategien zur Ausrichtung der KI entwickelt werden.

Ein weiterer innovativer Ansatz von OpenAI ist der Einsatz von Gegenspielern in Testszenarien. Indem absichtlich falsch ausgerichtete Modelle trainiert und überprüft werden, ob die Methoden auch die härtesten Abweichungen erkennen, kann die Effektivität des Superalignments erhöht werden.

Zusammenstellung eines spezialisierten Teams

OpenAI hat die Bedeutung des Superalignments erkannt und stellt ein Team zusammen, das sich auf die Steuerung und Kontrolle superintelligenter KI-Systeme spezialisiert. Dieses Team wird sich darauf konzentrieren, sicherzustellen, dass die KI im besten Interesse der Menschheit handelt.

Um seine Ziele im Bereich des Superalignments zu erreichen, widmet OpenAI einen erheblichen Teil seiner Ressourcen: ein ganzes Team, 20% seiner Ressourcen und gibt dem Projekt 4 Jahre.

Und wir werden es wohl alle sehen und erleben ob und wie die rasante Entwicklung der KI-Technologie im Einklang mit menschlichen Werten und Zielen stattfindet. Werden durch das Superalignment wirklich die Risiken, die mit der Entwicklung von Superintelligenz verbunden sind, minimiert und eine Zukunft geschaffen, in der KI zum Wohle der Menschheit beiträgt.

Quellen

https://twitter.com/OpenAI/status/1735349718765715913

https://openai.com/research/weak-to-strong-generalization

https://openai.com/blog/introducing-superalignment?ref=aiworldtoday.net